Такой контент нам не нужен

Как платформы и государства борются с распространением деструктивной информации

Существующий дисбаланс между нормотворчеством и реальной жизнью не позволяет властям оперативно реагировать на появление новых категорий противоправной информации. Соцсети используют алгоритмы для выявления и блокировки незаконного и опасного контента и в то же время напоминают о праве людей формировать собственную картину мира. Эксперты считают, что чиновникам и коммуникационным компаниям нужно быть в постоянном диалоге для нейтрализации по-настоящему деструктивного контента.

В ПОИСКАХ МЕТОДА

О регулировании государством цифровой среды сегодня спорят во всем мире. Британский регулятор Ofcom осенью запустил инициативу о повышении безопасности интернет-сообществ. Организации, которые хотят помочь людям, наиболее подверженным риску причинения вреда в интернете, могут подать соответствующие заявки на участие в тендерах, заявили в агентстве.

Ряд американских штатов в настоящее время лоббирует законы, которые ограничивают влияние технологических гигантов и запрещают крупным соцсетям модерировать контент пользователей.

Если документы будут приняты, у платформ останется минимум инструментов влияния на размещаемую в Сети информацию.

Пока в США идут юридические споры о цензуре в Сети и правовом статусе онлайн-площадок, Вьетнам приступил к подготовке правил для ограничения размещения новостей в соцсетях. В частности, министерство информации и коммуникаций страны решило, что не все учетные записи могут публиковать событийный контент.

Новые условия, которые подготовят до конца года, станут основанием для контроля за распространением новостей на Facebook*, YouTube и других платформах. Также правила позволят следить за пабликами, позиционирующими себя как аккредитованные информационные агентства, а по сути таковыми не являющимися.

ПЛОЩАДКИ И ГОСУДАРСТВО

Идея вьетнамского регулятора предполагает возложение значительного бремени модерации на платформы. Не удивительно, ведь именно коммуникационные гиганты сегодня являются центрами компетенций в борьбе с опасным контентом в Сети, отметил заместитель гендиректора Института развития интернета Борис Едидин на RIGF 2022.

Подобный подход, когда арбитрами выступают платформы, практикуется в Великобритании, Канаде и США. В основе принципов отнесения информации к деструктивной, хотя и легальной, лежит решение поставщика услуг, сообщила на RIGF 2022 директор Института проблем правового регулирования факультета права Национального исследовательского университета «Высшая школа экономики» Анна Дупан.

Эксперт отметила, что

понятие «деструктивный контент» становится все шире. Это уже не только противоречащая закону информация, как было ранее, но причиняющая вред пользователям и обществу негативным психологическим воздействием

Пока критерии этого определения размыты.

Анна Дупан, НИУ «Высшая школа экономики»:

– В Великобритании опасный контент делят на вредный для детей и взрослых. В Сингапуре нежелательную информацию разграничивают по тематическим категориям, и там готовятся методические рекомендации, как квалифицировать контент, связанный с сексуальным насилием, киберзапугиванием, а также способствующий росту преступности.

Борис Едидин напомнил, что в России закон, устанавливающий процедуру ограничения доступа к запрещенной информации, введен в действие в 2012 году. Тогда законодатель определил только три категории таковой – связанной с детской порнографией, пронаркотическим контентом и пропагандой суицидов. Однако часто закон не успевает за действительностью.

Борис Едидин, Институт развития интернета:

– От принятия механизма по борьбе с противоправным контентом до конкретных процедур, например, запрещающей размещать инструкции в Сети по изготовлению взрывчатки в 2021 году, прошло девять лет.

СТЕПЕНЬ ВРЕДНОСТИ

В VK считают: если информация в Сети прямо не нарушает законодательство, ее не стоит сразу считать деструктивной. В своем выступлении на RIGF 2022 директор по связям с государственными органами VK Константин Голуб отметил, что

размещаемый контент отражает те социальные процессы, которые происходят, ведь интернет – это зеркало общества

Нельзя все запретить и жестко вводить цензуру, лишая пользователей возможности определять собственную информационную картину, отметил он.

Константин Голуб, VK:

– Дополнительные регуляторные меры пока неочевидны, поскольку критерии определения деструктивной информации субъективны. Мы предпочитаем использовать термин «спорный контент». В первую очередь важно выяснить, почему он появился на площадке, у какой социальной группы есть интерес к нему и запрос.

Эксперт отметил, что запрет не всегда помогает остановить распространение информации и уж тем более не искореняет то или иное явление в обществе.

В VK стараются не блокировать сомнительный контент, а справедливо ограничивать к нему доступ, отметил эксперт.

«ВКонтакте» за 2021 год удалила 60 млн единиц контента, который не соответствовал правилам платформы или законодательству России

Это 1% от размещенных на площадке 6 млрд постов. Большинство материалов, нарушающих правила, блокировались до публикации.

Константин Голуб, VK:

– Мы активно работаем по обращениям пользователей – наша скорость реагирования составляет одну-две минуты. «ВКонтакте» в 2021 году сделала редизайн системы жалоб, ресурс стал более информативным и удобным.

Но весь спорный контент удаляться не может, подчеркнул он.

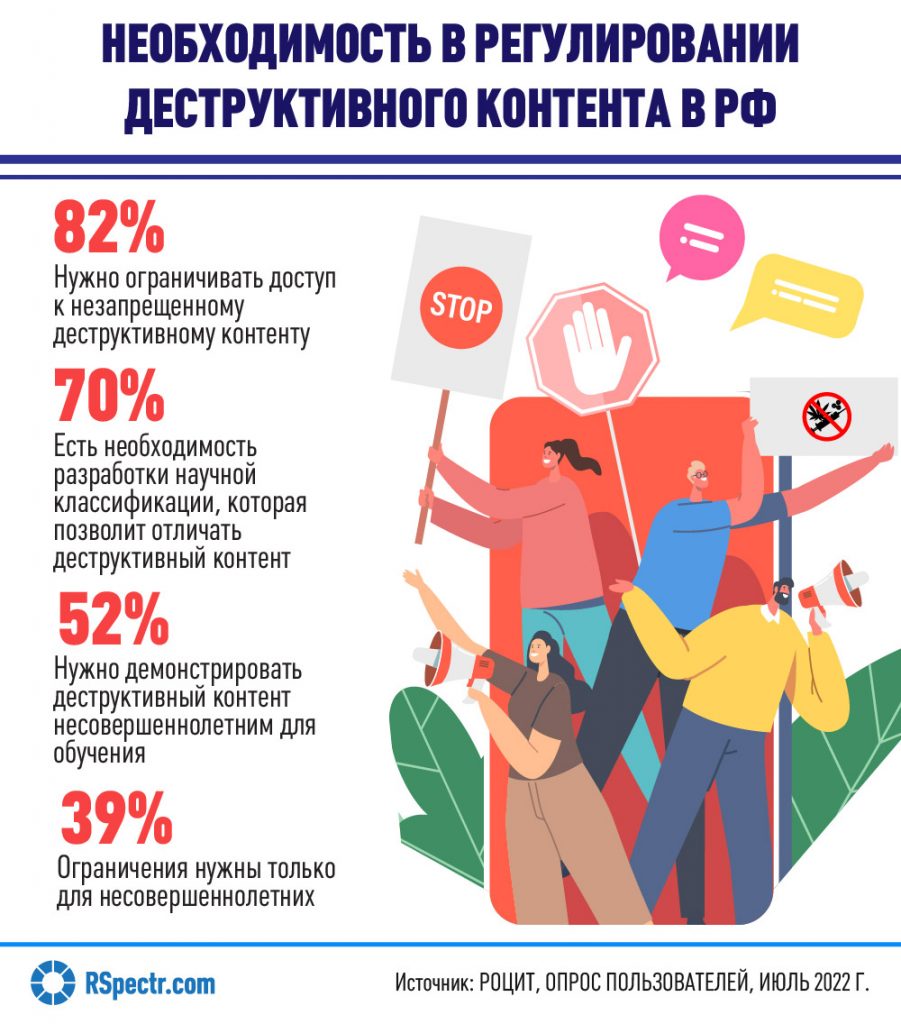

О ЧЕМ ДУМАЮТ ПОЛЬЗОВАТЕЛИ

Степень опасности той или иной размещенной в Сети информации выясняют общественные организации. В 2022 году «Центр интернет-технологий» (РОЦИТ) получил федеральный грант на исследования влияния деструктивного контента на граждан, рассказал заместитель председателя правления РОЦИТ Вадим Ампелонский.

Он отметил, что

около 75% пользователей платформ «Одноклассники» и «ВКонтакте» сталкивались с деструктивным контентом, более 24% опрошенных встречают его ежедневно

Более 43% отправляли жалобы, чаще в адрес платформ, в Роскомнадзор обращались лишь 2% респондентов.

Вадим Ампелонский, РОЦИТ:

– Почти половина опрошенных (44%) считает, что опасный, но не запрещенный контент надо блокировать, 22% полагает, что в отношении него должен быть запрет на попадание в рекомендации, 16% думает, что подозрительную информацию надо соответствующим образом маркировать.

Почти треть респондентов отметила, что после отправки запроса доступ к деструктивному контенту был ограничен. Однако четвертая часть обратившихся не получила обратной реакции от администраторов площадок.

Такого рода исследования нужно проводить не только на российских, но и на зарубежных платформах, и РОЦИТ будет этим заниматься, заключил Вадим Ампелонский.

Эксперты Научно-технического центра ФГУП «ГРЧЦ» привели данные саммита Массачусетского технологического института, где говорится, что Meta неохотно применяет методы сдерживания дезинформации: на площадке нет опции «подумать» перед нажатием кнопки «поделиться». Такой инструмент позволяет взять паузу, что сокращает распространение фейков на 10-15 процентов.

АЛГОРИТМЫ И ЗАКОН

Государство должно не выступать органом, который запрещает информацию, а помогать онлайн-площадке разбираться в спорных случаях, считает Борис Едидин. По его словам, прототип этого механизма уже действует в рамках закона о регулировании соцсетей.

Эффективность этого нововведения весьма высока: теперь площадки сами заинтересованы в отсутствии сомнительного контента и значительно усилили соответствующие службы, сообщил RSpectr зампред комитета Госдумы по информполитике Антон Горелкин.

Константин Голуб рассказал о гибридном методе модерации, когда администраторы экспериментируют с пользовательскими механиками.

Константин Голуб, VK:

– Мы предлагаем пользователю техники информирования, что может ожидать его на той или иной площадке, также возможность использования заглушек для неприятной информации, которая не запрещена законом.

В VK внедрена и технология цифровых отпечатков, которая позволяет оперативно удалять повторно выложенный опасный контент, а также размещенный с нарушением авторских прав.

С 2021 года в VK проходит эксперимент по внедрению нейросети для борьбы с враждебными высказываниями. Алгоритмы научились определять призывы к причинению вреда здоровью, угрозы расправы и автоматически удалять эти посты в сообществах, отметил эксперт. Протестировали эту функцию 12 млн пабликов, отказались от инструмента не более 2% сообществ.

В ближайшем будущем в парламент будет внесен законопроект, регулирующий рекомендательные алгоритмы в соцсетях. Его автор Антон Горелкин сообщил, что государство не ставит целью контроль за проектированием работы инструментов, которые останутся ноу-хау владельца того или иного сервиса. Но законодатели настаивают на праве пользователя знать основные принципы работы таких систем.

Антон Горелкин, Госдума:

– Они должны быть описаны доступным языком, с перечислением данных и параметров, которые собираются и обрабатываются для формирования рекомендаций.

Депутат отметил, что,

помимо существующей сегодня непрозрачности в создании алгоритмов, которая позволяет сервисам манипулировать и настраивать предпочтения определенным образом, их невозможно отключить

Рекомендательные сервисы, являясь по существу рыночным механизмом повышения качества предоставляемых услуг, не относятся к категории систем, способных оказать значительное влияние на права, свободы и благополучие людей и общества, считает глава Института исследований интернета Карен Казарян. Он пояснил RSpectr, что паника, создаваемая СМИ вокруг них, не имеет под собой фактического обоснования. Более того, существуют исследования, опровергающие влияние алгоритмов, отметил представитель ИИИ.

Обязать всех разработчиков любых рекомендательных сервисов учитывать все «подводные камни» невозможно, рассказал RSpectr руководитель практики машинного обучения и ИИ Axenix (экс-Accenture) Алексей Сергеев. По его словам, риски могут быть:

- контентные (предоставление противоправной информации);

- потребительские (склонение к покупке и введение в заблуждение о качествах товара/услуги);

- коммуникационные (знакомства в Сети, представляющие угрозу, кибербуллинг);

- в сфере информационной безопасности (действия, ведущие к утечке персональных данных) и т.д.

В любом случае, считает эксперт, это окажет существенное затормаживающие влияние на развитие технологий, в том числе востребованных сервисов персонализации товарных предложений. Новшество будет затратным для игроков рынка.

Алексей Сергеев, Axenix:

– Разработчику придется имплементировать в сервисе полноценный монитор безопасности и функции фильтрации контента, что является отдельной экспертной областью ИБ.

В борьбе с деструктивным контентом государству важно привлечь не только соцсети, но и регистраторов доменов и сайтов, резюмировал Борис Едидин. По его словам, негативная информация часто распространяется через пиратские и фишинговые ресурсы и их зеркала.

*Facebook, Instagram и WhatsApp (входят в Meta Platforms Inc., деятельность которой запрещена на территории РФ)

Наталия Черкасова