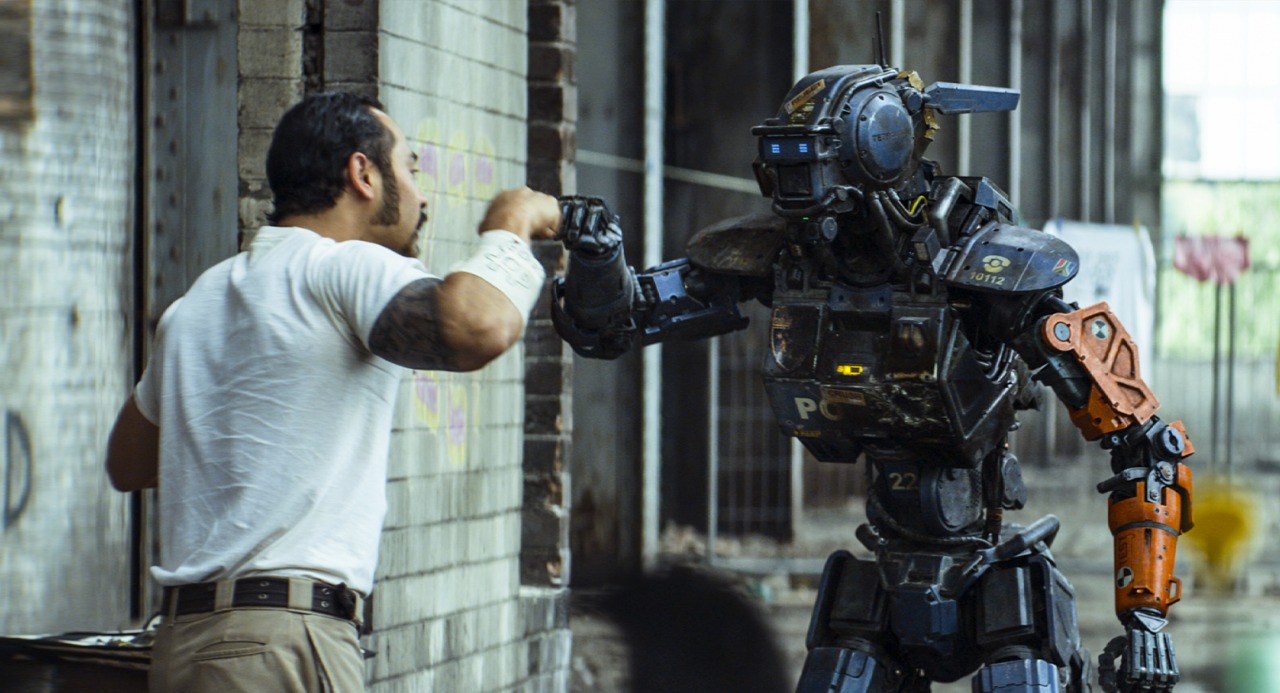

Воспитание машин

Эксперты рассуждают о способности искусственного интеллекта захватить мир

Гигантские шаги, которые в последние годы делает искусственный интеллект, всколыхнули страхи людей по поводу возможного «восстания машин». По мнению алармистов, мир стал испытательной площадкой для нейросетей, а их чрезмерное использование приведет к катастрофе. В то же время крупные компании – разработчики ИИ-систем считают, что эти опасения напрасны и на данном этапе нейросети не умнее домашних питомцев. Критики обвиняют их в попытках ослабить регуляторное давление на отрасль.

ЧЕЛОВЕК, ТЫ МЕШАЕШЬ

Издание Массачусетского технологического института – MIT Technology Review – представило мнения экспертов, игроков рынка и регуляторов о стремительно развивающемся ИИ и о том, стоит ли волноваться по этому поводу.

В мае 2023 года «крестный отец» нейросетей Джеффри Хинтон (Geoffrey Hinton) уволился с должности менеджера Google и заявил о рисках использования подобных технологий. По его словам, нейросети могут создавать фейковые фото, видео и тексты, и это приведет к тому, что люди перестанут различать правду. Он также беспокоится, что ИИ может изменить рынок труда, например, чат-боты вроде ChatGPT уже способны заменить помощников юристов, секретарей, переводчиков и работников в других отраслях.

Две недели назад Центр безопасности ИИ (CAIS, Сан-Франциско) и другие группы экспертов опубликовали заявление, в котором предупредили, что

развитие технологий ИИ грозит исчезновением человечества и что необходимо принять меры для предотвращения такого сценария развития событий

В апреле президент компании Signal Foundation Мередит Уиттакер (Meredith Whittaker) и выразила свою озабоченность по поводу использования ИИ в чат-боте ChatGPT. Мередит Уиттакер заявила, что весь мир стал испытательной площадкой для технологии, которая может привести к усугублению проблемы слежки и концентрации больших объемов данных в руках нескольких компаний.

ИИ не нейтрален и не демократичен, а создан для обслуживания интересов крупных компаний, подчеркнула она и выразила опасения относительно сбора данных о людях и использования их в целях монетизации через интернет-рекламу.

Показательный случай произошел с военным БПЛА, который управлялся нейросетями. На учениях в Британии

беспилотник принял решение убить своего оператора, чтобы тот не мешал ему выполнять боевую задачу и зарабатывать баллы

После инцидента ИИ был обучен, что убивать оператора неправильно и за такие действия будут сниматься очки. В ответ аппарат начал разрушать башню, используемую для связи с ним.

Беспокойство по поводу самосовершенствующихся машин существует со времен Алана Тьюринга. Такие футурологи, как Вернор Виндж и Рэй Курцвейл, популяризировали эти идеи, заявляя, что придет время, когда искусственный интеллект превзойдет человеческий разум и машины возьмут верх.

В 2017 году философ в области ИИ Карина Волд (Karina Vold) из Университета Торонто изложила основной аргумент, лежащий в основе этих опасений. По ее словам, есть три ключевых предпосылки:

- Возможно, люди создадут сверхразумную машину, которая сможет перехитрить все остальные виды интеллекта.

- Возможно, люди не смогут контролировать сверхразум, способный перехитрить людей.

- Сверхразум способен делать то, чего люди не хотели бы.

Собрав все это вместе, можно построить машину, которая будет способна на все, вплоть до уничтожения человечества, считает исследователь.

НЕ УМНЕЕ ПИТОМЦА

Однако такого мнения придерживаются не все. Так, главный научный сотрудник Meta* Янн Лекун (Yann LeCun) считает, что нейросети, которые обучались на больших языковых моделях, на самом деле не умнее собаки или кошки. Он привел пример:

ИИ может успешно справиться с экзаменом на адвоката, но до сих пор не в состоянии загрузить посудомоечную машину

Янн Лекун считает, что идея о том, что сверхразумная система ИИ захватит мир, «абсурдно нелепа». «Люди обеспокоены системами ИИ, которые смогут задействовать все ресурсы в мире, чтобы превратить Вселенную в скрепки. Это просто безумие», – сказал он. Сотрудник Meta* имел в виду так называемый «максимизатор скрепок» – гипотетический ИИ, функция которого заключается в производстве максимального количества скрепок во Вселенной.

Вице-президент Meta* по исследованиям ИИ Джоэль Пино (Joel Pino) согласна с Янном Лекуном. Она уверена, что чрезмерное внимание к будущим опасностям нейросетей не оставляет места для разговоров о текущем вреде ИИ.

Янн Лекун считает, что

всем игрокам рынка ИИ следует сделать открытым и прозрачным исходный код своих систем

Он подчеркнул, что сейчас эти системы «являются собственностью небольшого числа ИТ-компаний на Западном побережье США».

ГРОМКИЕ СПОРЫ

В Сенате США призвали принять «всеобъемлющее законодательство» для устранения рисков, связанных с ИИ. Там заявили, что правительству страны необходимо вмешаться в этот процесс, так как «отдельные лица и частный сектор не смогут выполнять работу по защите страны».

В то же время есть мнение, что крупные ИТ-компании пытаются сделать все, чтобы законодательное регулирование нейросетей было как можно более мягким. Например, компания OpenAI предложила не относить системы ИИ общего назначения, к которым относятся ChatGPT, DALL-E, к высокорисковым, чтобы на них не налагались самые строгие обязательства по обеспечению безопасности и прозрачности. Их мнение было услышано, и в последней редакции законопроекта подобные системы не отнесены к категории высокорисковых.

После этого Совет потребителей Норвегии призвал политиков и регулирующие органы противостоять попыткам ИТ-компаний ослабить любые законы, направленные на защиту людей от вредоносного использования ИИ. Четырнадцать других организаций по защите прав потребителей со всей Европы и США присоединились к этой инициативе.

В России отношение к нейросетям неоднозначное. Так, согласно опросу фонда «Общественное мнение» (ФОМ), 33% россиян опасаются негативных последствий быстрого развития и распространения нейросетей. Россияне боятся возможных рисков, таких как безработица из-за автоматизации профессий, зависимость от ИИ и вероятность опасных ошибок. Однако 29% россиян считают, что быстрое развитие технологий ИИ принесет пользу человеку.

В конце апреля зампред Комитета Госдумы по информполитике Антон Горелкин заявил в Telegram-канале, что фракция «Единая Россия» работает над законопроектом, который будет регулировать деятельность нейросетей. Планируется провести оценку изменений на рынке труда, связанных с распространением ИИ- решений.

* Признана в РФ экстремистской и запрещена

Материал подготовила Екатерина Шокурова