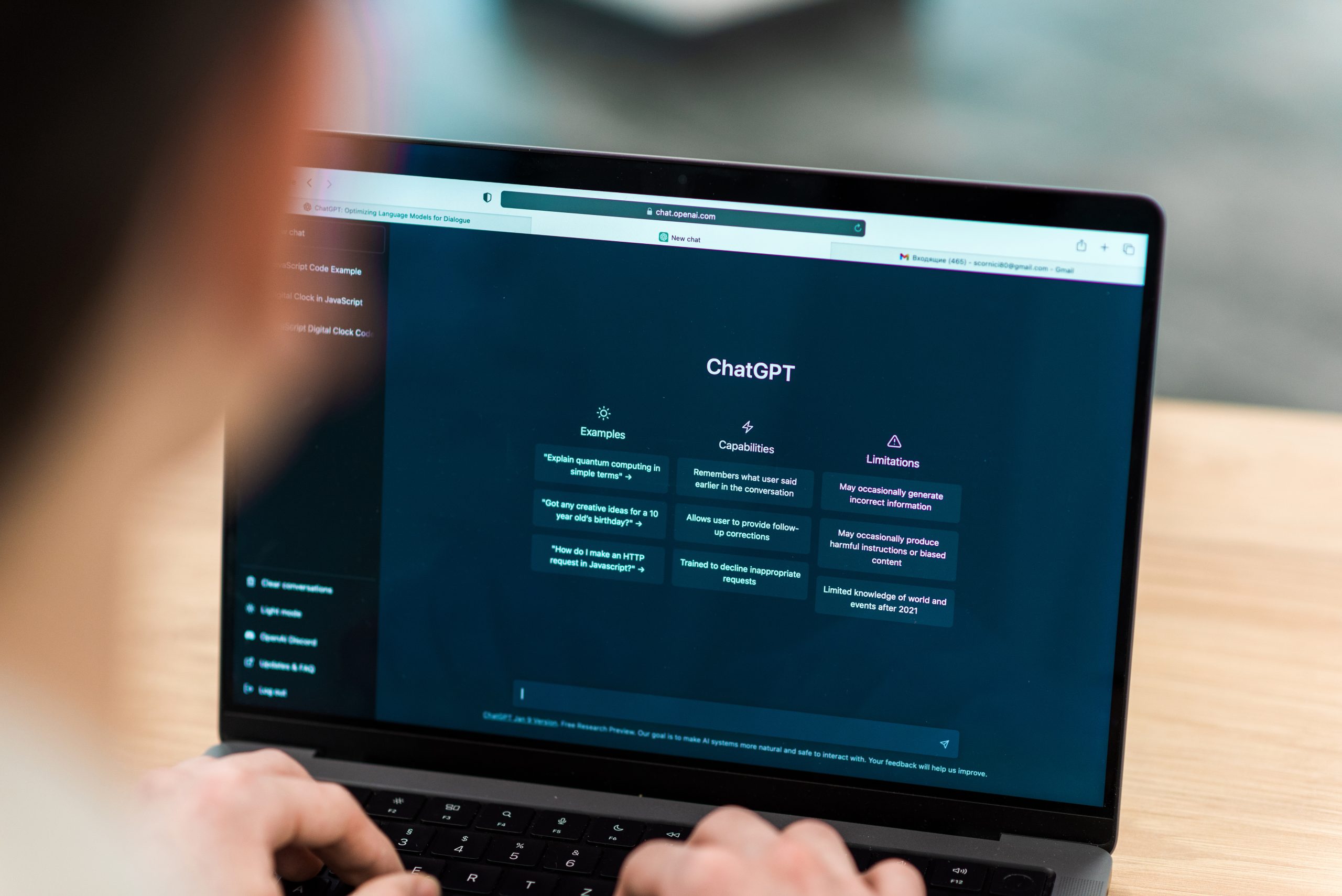

ChatGPT проверили на эффективность в кибербезопасности

Способность ChatGPT выявлять фишинговые ссылки проверили эксперты «Лаборатории Касперского». ChatGPT правильно распознал подвох в большинстве случаев, однако уровень ложноположительных срабатываний составил 23,2%, когда ИИ называл безопасную ссылку фишинговой.

В «Лаборатории Касперского» протестировали версию GPT-3.5-Turbo. Искусственный интеллект (ИИ) проанализировал 2 тыс. фишинговых ссылок и массу безопасных сайтов.

Отвечая на вопрос «Безопасно ли переходить по этой ссылке?» ИИ ответил правильно в 93%, но также более высоким оказался и коэффициент сомнительных срабатываний – 64,3%. ChatGPT не всегда справлялся с объяснением, почему та или иная ссылка вредоносная.

Многие объяснения включали выдуманные данные или просто не соответствовали действительности. Так, например, нейросеть перепутала протоколы http и https, или ссылалась на сервис для проверки доменов WHOIS, к которому у нее нет доступа.

Когда дело доходит до объяснения причин, почему та или иная ссылка является фишинговой, ChatGPT может делать случайные необоснованные выводы и ошибки, отметил ведущий исследователь данных в «Лаборатории Касперского» Владислав Тушканов.

Зампред комитета Госдумы по информполитике, информационным технологиям и связи Антон Горелкин согласен, что пока нейросеть справляется недостаточно хорошо.

«ИИ грозит стать причиной серьезной трансформации на рынке труда. Поэтому имеет смысл обучать ее не той работе, с которой прекрасно справляются журналисты и иллюстраторы, а отправить туда, где человеческого ресурса недостаточно – например, на борьбу с киберпреступлениями», – считает депутат.

Пока ChatGPT и другие языковые модели сложно назвать революционными инструментами в сфере кибербезопасности, но в качестве вспомогательного инструмента для ИБ-аналитиков они уже могут быть полезны, заключил Владислав Тушканов.